Hallucinaties in AI

09/12/2025

Model Context Protocol (MCP)

12/02/2026Retrieval-Augmented Generation (RAG)

Waarom AI met RAG ineens wél te vertrouwen is

Voor veel mensen voelt AI nog steeds als een blackbox. Je stelt een vraag, krijgt een overtuigend antwoord, maar wat gebeurt er daarachter eigenlijk? En belangrijker: waar komt die informatie vandaan?

Retrieval-Augmented Generation (RAG) is een van de technieken die juist op dat punt het verschil maakt. Niet door AI slimmer te maken, maar door het betrouwbaarder, controleerbaarder en praktischer te maken. Precies wat nodig is om AI serieus in te zetten binnen organisaties.

Datum

08-01-2026

Categorie

Inzichten & inspiratie

Auteur

Pleun Claassen

Wat is RAG?

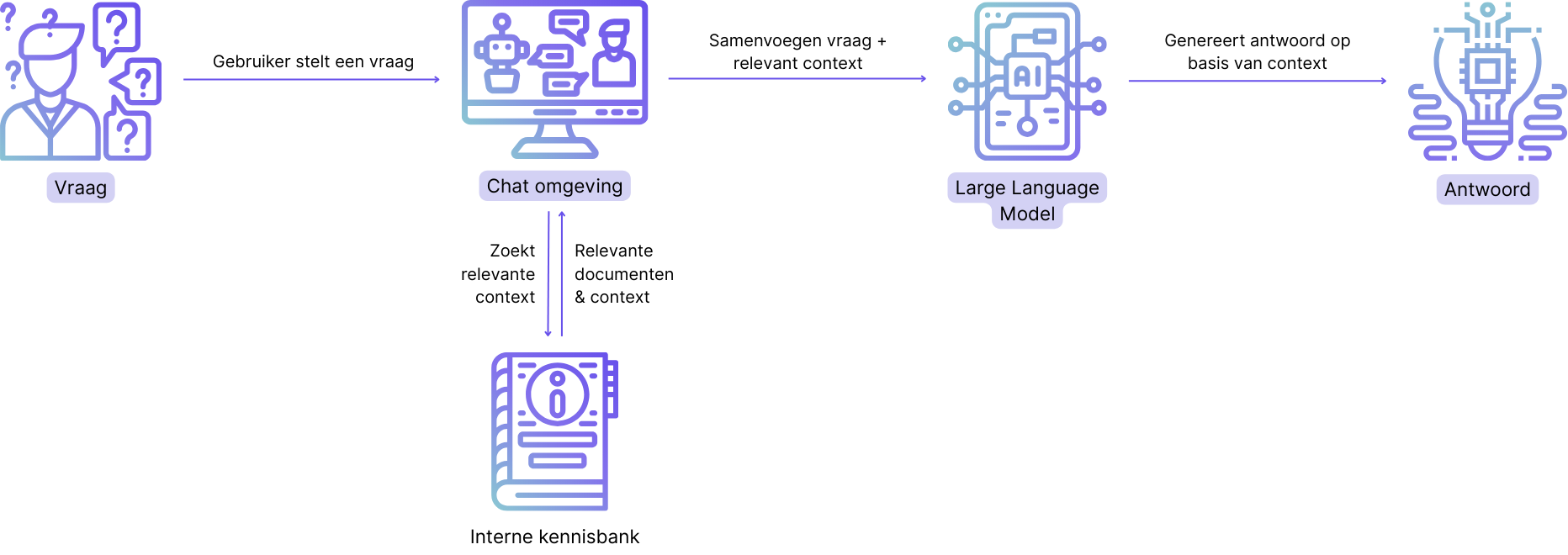

RAG staat voor Retrieval-Augmented Generation. In gewoon Nederlands: een techniek waarbij een AI-taalmodel eerst gericht informatie ophaalt uit een kennisbron, en die informatie vervolgens gebruikt als basis voor het genereren van een antwoord.

Het bestaat uit twee stappen die de naam al verklappen: retrieval (ophalen) en generation (genereren). Eerst zoeken, dán antwoorden. Klinkt logisch. En toch is dit een fundamentele verbetering ten opzichte van hoe de meeste AI-systemen standaard werken.

Waarom hallucineert AI zonder RAG?

Voor veel mensen voelt AI nog steeds als een blackbox. Je stelt een vraag, krijgt een overtuigend antwoord, maar wat er daárachter gebeurt? En belangrijker: waar komt die informatie vandaan? Zie een taalmodel als een slimme collega met een uitstekend taalgevoel. Iemand die razendsnel verbanden legt, overtuigend formuleert en vrijwel overal wel iets zinnigs over kan zeggen. Maar net als die collega heeft een taalmodel ook een duidelijke beperking: het beschikt niet automatisch over jouw interne documenten, actuele beleidsstukken of organisatiespecifieke kennis. Alles wat buiten zijn directe context valt, kent het simpelweg niet.

Wanneer zo'n model tóch een antwoord moet geven over iets wat het niet weet, valt het terug op patronen uit zijn training. Het probeert dan het meest waarschijnlijke, logisch klinkende antwoord te formuleren, ook als de benodigde informatie eigenlijk ontbreekt. Precies daar ontstaan hallucinaties: antwoorden die overtuigend en vloeiend zijn, maar inhoudelijk onjuist, incompleet of deels verzonnen. Niet omdat het model "liegt", maar omdat het geen onderscheid kan maken tussen wat het weet en wat het logisch vindt klinken.

Meer weten over hallucinaties? Check dan onze blog over hallucinaties in AI.

Hoe lost RAG dit op?

RAG verandert het speelveld fundamenteel. In plaats van te gokken of aannames te doen, krijgt het taalmodel vooraf concrete, relevante context aangereikt. Dat klinkt misschien als een kleine ingreep, maar het effect is groot.

Het proces werkt in twee stappen:

- Stap 1 - Ophalen: Wanneer je een vraag stelt, doorzoekt het systeem doelgericht de beschikbare kennisbase op relevante informatie. Dit gebeurt via semantisch zoeken: niet op exacte woorden, maar op betekenis. Daardoor worden ook documenten gevonden die inhoudelijk aansluiten, zelfs als ze andere termen of formuleringen gebruiken.

- Stap 2 - Genereren: De gevonden passages worden meegegeven aan het taalmodel als context. Het model "leest" deze input als extra achtergrond en gebruikt die om zijn redenering te structureren.

Het resultaat? Een antwoord dat niet alleen inhoudelijk klopt, maar ook herleidbaar is naar concrete bronnen. AI spreekt daarmee niet meer over jouw organisatie vanuit algemene aannames, maar vanuit jouw organisatie, met antwoorden die aansluiten op de werkelijkheid van dat moment. Van slimme prater naar onderbouwde collega, zeg maar.

Wat is het verschil tussen RAG en fine-tuning?

Een veelgestelde vraag. Fine-tuning betekent dat je een AI-model naderhand nóg eens traint op jouw specifieke data. Het model leert zo meer over jouw domein. Klinkt ideaal, maar er zitten haken en ogen aan: het is technisch intensief, duur, en zodra jouw informatie verandert, is het model alweer verouderd.

RAG werkt anders. De kennisbase bestaat buiten het model en kan op elk moment worden bijgewerkt. Voeg een nieuw beleidsdocument toe, en het systeem gebruikt het direct. Geen hertraining vereist.

Dat maakt RAG bijzonder geschikt voor omgevingen waar informatie regelmatig verandert, en dat is in de meeste organisaties gewoon de realiteit.

Waarom maakt RAG AI zoveel betrouwbaarder?

De echte kracht zit in risicoreductie. Doordat antwoorden expliciet worden opgebouwd op basis van geselecteerde broninformatie, verklein je de ruimte voor interpretatie en aannames drastisch. Het taalmodel hoeft geen ontbrekende kennis meer te "reconstrueren", maar werkt binnen duidelijke inhoudelijke kaders.

Dat levert drie concrete voordelen op:

- Minder hallucinaties. Het model baseert antwoorden op aangeleverde bronnen in plaats van aannames. De kans op verzonnen feiten neemt significant af.

- Actuele kennis zonder hertraining. Nieuwe documenten, aangescherpte richtlijnen, aangepaste processen, ze zijn direct beschikbaar in antwoorden, zonder complexe technische trajecten.

- Uitlegbaarheid en governance. Omdat zichtbaar is welke bronnen zijn gebruikt en hoe conclusies tot stand komen, wordt AI toetsbaar. Je kunt antwoorden controleren, auditen en verbeteren. Dat is een sleutelvoorwaarde om AI van experiment naar volwassen bedrijfsinstrument te brengen.

Waar zie je RAG in de praktijk terug?

Interne kennisvragen

De kracht van RAG wordt het meest zichtbaar in kennisintensieve processen. Denk aan medewerkers die snel antwoord willen op vragen over beleid, HR-regelingen of IT-procedures. Met RAG kan een AI-assistent antwoorden formuleren op basis van actuele interne documentatie, waardoor informatie sneller én consistenter beschikbaar is, zonder interpretatieverschillen tussen collega's.

Klant- en supportafhandeling

In plaats van generieke antwoorden kan een RAG-gestuurde AI reageren op basis van productspecificaties, handleidingen en eerdere cases. Dat resulteert in accuratere antwoorden, minder escalaties naar de tweede lijn en een hogere klanttevredenheid. En zodra documentatie wordt aangepast, werkt de kennisbase automatisch mee.

Analyse en besluitvorming

Denk aan het samenvatten van rapporten, contracten of beleidsstukken, of het beantwoorden van managementvragen op basis van meerdere interne bronnen. RAG zorgt ervoor dat conclusies expliciet zijn onderbouwd met bestaande informatie, zodat beslissingen niet worden genomen op gevoel of aannames, maar op gedeelde en controleerbare kennis.

Wanneer is RAG niet de beste keuze?

Eerlijk is eerlijk: RAG werkt het best wanneer antwoorden kunnen worden afgeleid uit bestaande documenten. Voor creatieve taken, open redeneerprocessen of situaties waarbij geen geschikte kennisbase beschikbaar is, levert RAG minder toegevoegde waarde. In die gevallen is een goed geconfigureerd generatief model of fine-tuning soms een betere keuze.

AI wordt niet slimmer met RAG, maar wel bruikbaarder

RAG maakt AI niet magisch intelligenter. Het onderliggende taalmodel blijft hetzelfde. Wat verandert, is de context waarin het werkt. En juist die context bepaalt of AI een leuke demo blijft, of uitgroeit tot een serieuze digitale collega die je kunt vertrouwen in dagelijkse processen.

Bij Univia werken we dagelijks met dit soort technieken om AI veilig en praktisch inzetbaar te maken. Benieuwd waar RAG binnen jouw organisatie concreet waarde toevoegt, en waar (nog) niet? Dan praten we daar graag eens rustig over. Bij ons op de High Tech Campus in Eindhoven staat de koffie altijd klaar.

Altijd als eerste het nieuws van Univia ontvangen?

Volg ons op social media, en houd onze blog pagina in de gaten voor de laatste updates! Of schrijf je nu in voor onze nieuwsbrief!